Laser-stripe Profiler (2003‒2007)

Design

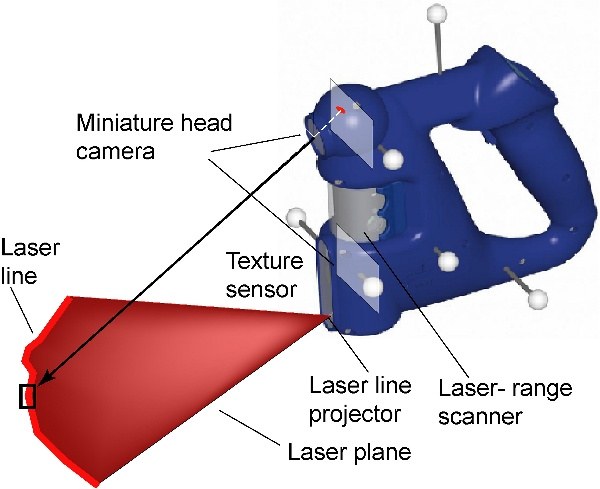

Die Abbildung veranschaulicht das Grundprinzip der Entfernungsmessung durch optische Triangulation. Ein Laserfächer beleuchtet einen Streifen auf der Oberfläche eines Objekts. Eine Videokamera (in unserem Fall ohne optische Filterung) erfasst seine Reflexion. Die 3-D-Rekonstruktion erfolgt mittels Triangulation, d. h. Kreuzen der Laserebene mit den Strahlen der Optik, die der Laserstreifenprojektion im Bildrahmen entsprechen.

Hierbei ist zu beachten, dass dieses Funktionsprinzip dem eines Stereosichtsystems stark ähnelt. Anstelle einer zweiten Kamera wird ein Laserfächer verwendet, um das Korrespondenzproblem zu vereinfachen. So lässt sich das größte Hindernis für die Verwendung eines Stereosichtsystems in der 3D-Modellierung mit hoher Rate – und zwar die rechnerischen Anforderungen – überwinden.

Systemkalibrierung

Die Genauigkeit des Lichtschnittsensors hängt in hohem Maße vom Kalibrierprozess ab. Der Sensor muss sowohl im Hinblick auf seine geometrischen als auch seiner optischen Eigenschaften höchst präzise kalibriert werden.

Die Kalibrierung der Videokamera wurde mithilfe der Kamera-Kalibrations-Toolbox bestehend aus DLR CalDe und DLR CalLab durchgeführt.

Bei der Kalibrierung der Laserebene wird die relative räumliche Lage (Position und Orientierung) der Laserebene im Verhältnis zum Sensorreferenzrahmen bestimmt. Dies ist ein besonders kritischer Punkt, da eine Fehlkalibrierung beim Abtastvorgang zu Fehlausrichtungen und Verzugseffekten bei den resultierenden Oberflächen führt. Wir haben eine innovative Selbstkalibrierungsmethode umgesetzt, die auf einer Bewertung der Verformungen beruht, die durch diese Fehlkalibrierung verursacht werden.

Bei der Schätzung der räumlichen Lage der Laserebene sind drei unabhängige Freiheitsgrade (DoF) zu erkennen. Aus Ungenauigkeiten der Schätzung jeder dieser Freiheitsgrade folgen verschiedene Festkörpergeometrie-Rekonstruktionsfehler – für jede Abtastbewegung des handgeführten Geräts. Dazu gehören einfache Skalierungsfehler bis hin zu konvex/konkavgewölbten Verformungen oder sogar unregelmäßig verzogenen Ergebnissen.

Unsere Methode zur Selbstkalibrierung funktioniert wie folgt: Zunächst verläuft der Rekonstruktionsvorgang auf Basis einiger erster Kalibrierparameter für die Laserebene, die im Vorfeld grob geschätzt wurden. Die vorgeschlagene Methode nutzt die Verzerrungen, die während dieses ersten Rekonstruktionsvorgangs auftreten. Als Kalibrierfläche verwenden wir eine Ebene mit unbekannter räumlicher Lage, sowohl um die Konstruktion eines komplexen Kalibrierkörpers zu umgehen als auch aufgrund der Tatsache, dass eine Ebene die geometrische Form besitzt, die am einfachsten zu validieren ist. Nach der Abtastung der Kalibrierebene weist die rekonstruierte Punktwolke Ungleichmäßigkeiten auf, wenn die Abtastung aus sehr unterschiedlichen Blickwinkeln erfolgt – theoretische Untersuchungen bestimmen das ideale Verfahren. Anschließend wird die am besten passende Kalibrierkörperebene für diese Punkte geschätzt - dieses Problem der Überbestimmung wird durch Verwendung einer geschlossenen Lösung in Form einer Singulärwertzerlegung gelöst. Schließlich werden die optimierten Laserfächerparameter offline geschätzt – mit dem Ziel, den mittleren quadratischen Abstand jedes rekonstruierten Punktes zur passendsten Ebene zu minimieren. Zur numerischen Optimierung wurde das Simplex-Verfahren nach Nelder und Mead angewendet. Darüber hinaus wird zur Schätzung der Präzision der errechneten Ergebnisse ein Erweiterter Kalman-Filter verwendet.

Kurz gesagt werden die Laserfächerparameter so angepasst, dass die abgetastete Fläche letzten Endes möglichst flach wird.

Laserstreifensegmentierung

Um eine noch größere Vielzahl von Objekten messen zu können, verfügt der Bildverarbeitungsalgorithmus über keine genauen Vorkenntnisse zur Form der Laserprojektionen. Daher können Spiegelreflexionen oder rote Lichtquellen zu fehlerhaften Ergebnissen führen, da sie bei einem gewöhnlichen Segmentierungsalgorithmus fälschlicherweise als Laserprojektionen interpretiert würden. Darüber hinaus erhöht das Fehlen einer optischen Filterung bei der Erfassung von Laserstreifenbildern die Fehleranfälligkeit. Aus diesen beiden Gründen ist eine zuverlässige Methode zur Streifensegmentierung erforderlich. Um die Zahl der Fehler dieser Art zu reduzieren, müssen neuartige Maßnahmen ergriffen werden.

Unser Ansatz basiert auf einem Softwarealgorithmus zur Streifenranderkennung. Dieser Algorithmus zur Detektion der oberen und unteren Streifenkante basiert auf dem Sobel-Operator. Darüber hinaus wurden zwei Validierungsstufen integriert: eine Farb- und eine Linienbreitenvalidierung (in Form von Online-Zuordnungstabellen). Die Farbvalidierung ist sehr nützlich, um die Problematik der Spiegelreflexionen zu bewältigen, außerdem erzielt sie eine hohe Robustheit und Flexibilität in Bezug auf wechselnde Lichtverhältnisse. Die Validierung der Linienbreite hat zum Ziel, Spiegelreflexionen des Lasers auszublenden. Darüber hinaus werden hierdurch Fehlmessungen im Bereich von Objektecken korrigiert.

Schließlich wird der zentrale Punkt des Streifens mithilfe des Massenschwerpunktverfahrens über dem roten Bildkanal mit einer Genauigkeit geschätzt, die im Subpixelbereich liegt (d.h. auf den Bruchteil eines Pixels genau). Die Helligkeitssättigung – die bei filterlosen Kameras, die Laserlichtreflexionen erfassen, mit hoher Wahrscheinlichkeit vorliegt – schließt Methoden wie die Gauß‘sche Approximation aus.

Lichtschnittsensor in Einzel- und Doppel-Fadenkreuz-Ausführung

Oft wird gesagt, dass man einen Sensor dieser Art praktisch genauso handhaben kann wie eine Dose Sprühfarbe - vor allem, wenn der Sensor an einem Handgerät befestigt ist. Das ist allerdings nicht ganz korrekt, da man während der Datenerfassung nicht die Freiheit hat, den Sensor horizontal in der Fächerebene zu bewegen, sondern nur Auf-/Abbewegungen möglich sind. Beim automatischen 3-D-Scannen durch einen Roboter wird dieser hierdurch in seiner Bewegung eingeschränkt, was den Verlust eines Freiheitsgrades zur Folge hat.

Damit es nicht zu dieser Einschränkung kommt, verwenden wir einen zusätzlichen Laserstrahl, der senkrecht zum ersten Streifen beleuchtet (daher Fadenkreuz). Aufgrund konstruktiver Zwänge müssen beide Laserstrahlen nah beieinander liegen. Da diese Anordnung eine unerwünschte Verringerung der Basisentfernung zwischen jedem Laserstrahl und der Kamera zur Folge hat, haben wir uns für die Verwendung der zweiten Kamera des DLR 3-D-Modelers entschieden, damit jede der Kameras eine einzelne Lichtschnittsensor-Abtastung mit dem am weitesten entfernt liegenden Laserfächer ausführen kann. Diese Konfiguration bezeichnen wir als Doppel-Fadenkreuz-Lichtschnittsensor. Zusammengefasst bedeutet die Hinzufügung eines zweiten miniaturisierten Laserstrahls: 1. die Vermeidung einer Einschränkung im Hinblick auf die Abtastbewegung, 2. der Zuwachs der in jeder Richtung gewonnenen Oberflächeninformationen, und 3. die Möglichkeit, die Datenerfassungsrate zu verdoppeln, da beide Kameras und Laserstrahlen komplementär, mit höherer Geschwindigkeit und begrenzter Belichtungszeit ausgelöst werden.

Fehlermodellierung

Um die Rekonstruktionsgenauigkeit zu verbessern und um anspruchsvollere Aufgaben wie Datenfusion, Exploration und Meshing zu ergänzen, wurde ein stochastisches Modell zum Festkörpergeometrie-Rekonstruktionsprozess entwickelt. Dieses stochastische Modell kombiniert systematische und zufällige Fehler und ist in Bezug auf die empirischen Kalibrierergebnisse parametrisiert.

Veröffentlichungen

K. H. Strobl, W. Sepp, E. Wahl, T. Bodenmueller, M. Suppa, J. F. Seara, and G. Hirzinger. “The DLR Multisensory Hand-Guided Device: The Laser Stripe Profiler.” Proceedings of the IEEE International Conference on Robotics and Automation (ICRA 2004), New Orleans, LA, USA, pp. 1927-1932, April 2004.